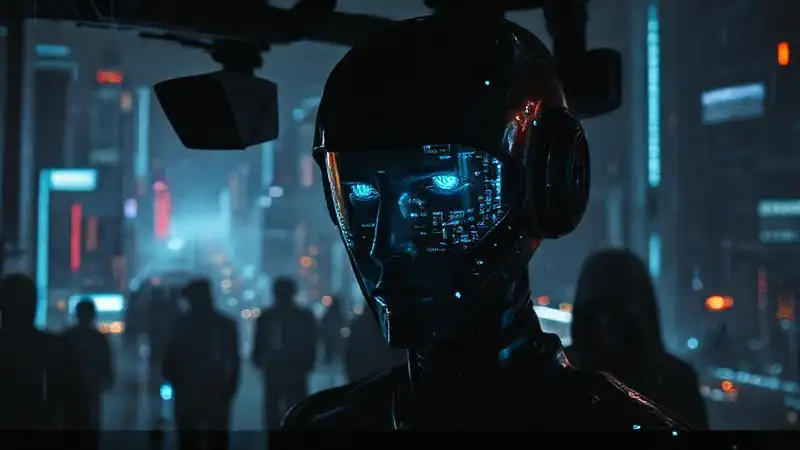

La inteligencia artificial (IA) está transformando rápidamente casi todos los aspectos de nuestras vidas, y el sector tecnológico no es una excepción. Desde recomendaciones personalizadas hasta la conducción autónoma, la IA se está integrando cada vez más en las aplicaciones y dispositivos que utilizamos a diario. Sin embargo, esta proliferación de IA plantea serias cuestiones éticas, especialmente cuando se combina con tecnologías como la vigilancia. En este contexto, la posibilidad de que Android, el sistema operativo móvil más utilizado a nivel mundial, permita la inclusión de IA en aplicaciones de vigilancia es un tema que merece una reflexión profunda y un debate abierto.

La línea divisoria entre la conveniencia y la privacidad se vuelve cada vez más difusa a medida que la IA se vuelve más sofisticada. El potencial de la IA para analizar grandes cantidades de datos y detectar patrones que los humanos podrían pasar por alto es innegable, pero también es importante considerar las posibles consecuencias negativas de la vigilancia masiva y el uso indebido de la información recopilada. La discusión sobre si Android debería o no permitir esta integración plantea un dilema fundamental: ¿Cómo podemos equilibrar los beneficios de la IA con la necesidad de proteger la libertad y la privacidad individual?

La Potencialización de la Vigilancia

La introducción de la IA en las aplicaciones de vigilancia de Android no solo aumenta la capacidad de monitoreo, sino que también la hace más eficiente. Los algoritmos de aprendizaje automático pueden analizar video en tiempo real, identificar rostros, detectar comportamientos sospechosos y, en general, crear perfiles de individuos y grupos. Esto representa un cambio radical con respecto a los métodos de vigilancia tradicionales, que a menudo eran manuales, lentos e ineficientes. Además, la IA puede aprender y adaptarse con el tiempo, mejorando su precisión y eficacia en la detección de amenazas.

El impacto de esta mejora en la eficiencia se extiende a la vigilancia policial, la seguridad pública y la gestión de multitudes. Por ejemplo, las aplicaciones de vigilancia impulsadas por IA podrían ayudar a prevenir delitos, rastrear individuos fugitivos o controlar el flujo de personas en eventos públicos. Sin embargo, la misma capacidad para detectar anomalías también podría utilizarse para reprimir la disidencia política o para llevar a cabo vigilancias masivas de la población civil. El potencial de abuso es real y requiere una supervisión cuidadosa.

Preocupaciones sobre la Privacidad

La recopilación y el análisis masivo de datos personales a través de aplicaciones de vigilancia impulsadas por IA plantean serias preocupaciones sobre la privacidad. Incluso si los datos se anonimizan y se utilizan solo con fines legítimos, existe el riesgo de que puedan ser re-identificados mediante técnicas de análisis avanzadas. La combinación de datos de diferentes fuentes, como cámaras de seguridad, redes sociales y registros de ubicación, podría crear perfiles de individuos que revelen información sensible sobre sus vidas, sus hábitos y sus relaciones.

Además, la simple presencia de aplicaciones de vigilancia en los dispositivos Android genera un clima de desconfianza y puede sofocar la libertad de expresión. Los usuarios pueden sentirse observados y controlados, lo que podría afectar su comportamiento y su disposición a participar en actividades políticas o sociales. La transparencia sobre cómo se recopilan, utilizan y comparten los datos es crucial para mitigar estos riesgos, pero a menudo es difícil de garantizar en la práctica.

El Riesgo de Sesgos Algorítmicos

La IA no es inherentemente objetiva; refleja los sesgos presentes en los datos con los que se entrena. Si los datos utilizados para entrenar los algoritmos de vigilancia están sesgados, la IA podría discriminar a ciertos grupos de personas basándose en su raza, género, religión o cualquier otra característica. Por ejemplo, si un sistema de reconocimiento facial se entrena principalmente con imágenes de personas blancas, es probable que tenga dificultades para identificar con precisión a personas de otras razas.

Estos sesgos algorítmicos pueden tener consecuencias graves, como la detención injusta de personas, la discriminación en el acceso a servicios o la perpetuación de estereotipos negativos. Es fundamental que los desarrolladores de IA estén conscientes de estos riesgos y que tomen medidas para mitigar los sesgos en sus algoritmos. La evaluación continua y la auditoría independiente son esenciales para garantizar la equidad y la justicia.

La Necesidad de Regulación y Supervisión

La integración de la IA en las aplicaciones de vigilancia de Android requiere un marco regulatorio sólido y una supervisión independiente. Los gobiernos deben establecer normas claras sobre la recopilación, el uso y el intercambio de datos personales, así como sobre la transparencia y la rendición de cuentas de los algoritmos de IA. Las leyes de protección de datos, como el Reglamento General de Protección de Datos (RGPD) en Europa, pueden servir como base para estas regulaciones, pero es posible que se necesiten nuevas leyes específicas para abordar los desafíos únicos que plantea la IA.

Además, es importante que haya mecanismos independientes para supervisar el uso de la IA en la vigilancia y para investigar las denuncias de abuso o discriminación. Estos mecanismos podrían incluir comités de ética, agencias de control de privacidad y organizaciones de la sociedad civil. La colaboración entre gobiernos, empresas tecnológicas y organizaciones de la sociedad civil es esencial para garantizar que la IA se utilice de manera responsable y ética.

Conclusión

La posibilidad de permitir la integración de la IA en aplicaciones de vigilancia de Android presenta un desafío ético complejo, que requiere una consideración cuidadosa y una acción proactiva. Si bien la IA ofrece el potencial de mejorar la seguridad y la eficiencia, también plantea serias amenazas a la privacidad, la libertad y la igualdad. Es imperativo que se establezcan salvaguardias sólidas para proteger los derechos de los ciudadanos y prevenir el abuso de esta tecnología.

No obstante, ignorar completamente los beneficios potenciales de la IA en la vigilancia podría ser igualmente problemático. La clave reside en encontrar un equilibrio entre la seguridad y la privacidad, y en garantizar que la IA se utilice de manera responsable y transparente. El debate sobre si Android debería permitir esta integración debe ser un proceso continuo, impulsado por la reflexión crítica y la participación pública, con el objetivo final de proteger los valores democráticos y los derechos humanos en la era de la inteligencia artificial.